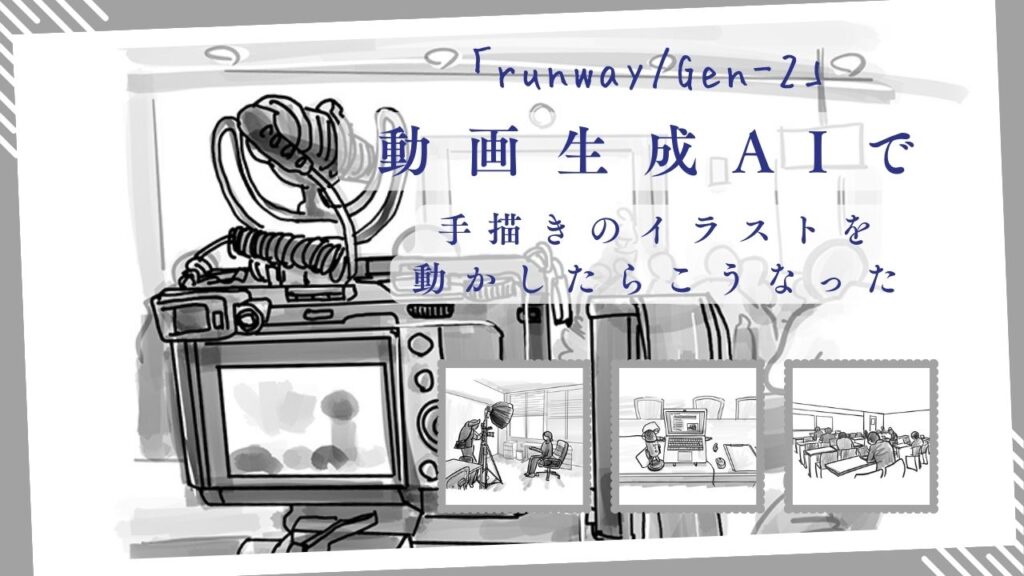

動画生成AIで、手描きのイラストを動かしたらこうなった

生成AIの進化により、動画生成も簡単にできるようになってきました。

今やネット上には「いかにもAIが生成しました」という画像や動画であふれている。

そこでふと考えました。

「自分が描いたイラストを動かしてみるとどうなんだろう」

試してみたところ、いくつかの発見があったのでまとめてみました。

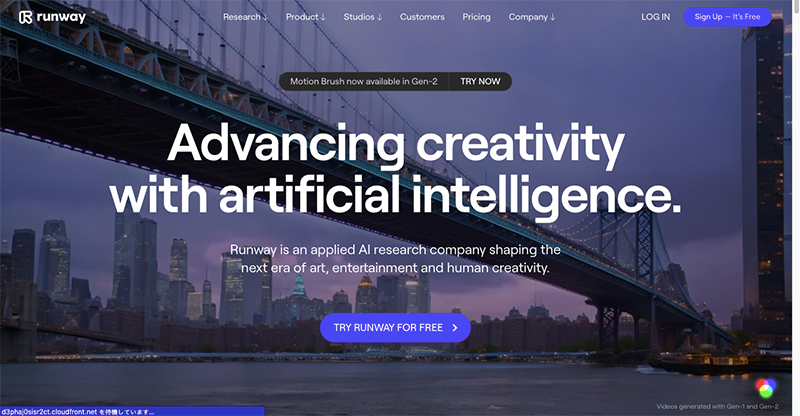

動画生成AI「runway/Gen-2」

今回使用したのは、動画生成AI「runway/Gen-2」です。

次のようなステップで動画を生成しました。

(1)「runway」にアクセスする

「runway/Gen-2」

https://runwayml.com/

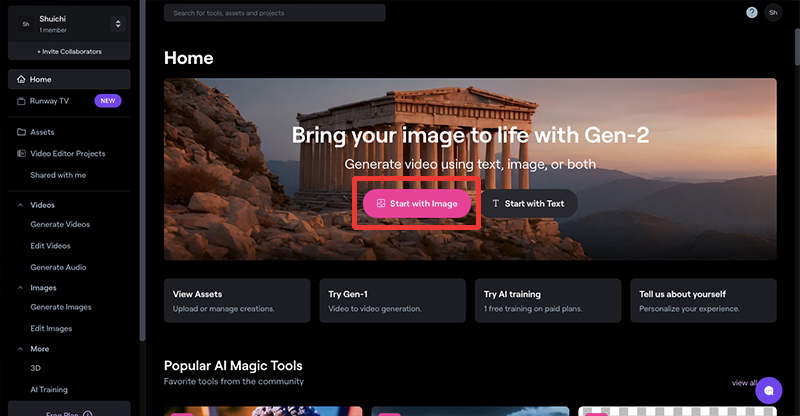

(2)登録してログインする

「Start with Image(画像でスタート)」をクリック。

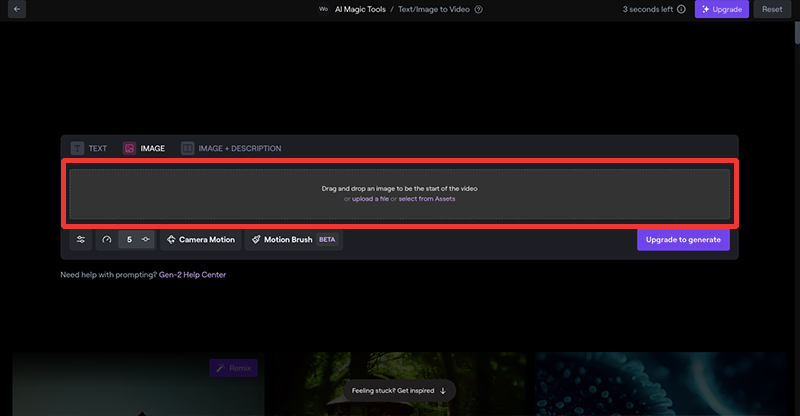

(3)動画を生成する

描いたイラストを、赤い線で囲った部分にドラッグして、動画を生成します。

※すでに無料プランの範囲を使い切ってしまった画面になっています。

たったこれだけの工程で、4秒間の動画が生成されます。

サイズは1024ピクセル×768ピクセル。

画面は英語ですが、シンプルなのでスムーズに使えます。

適当に動画生成してみたら

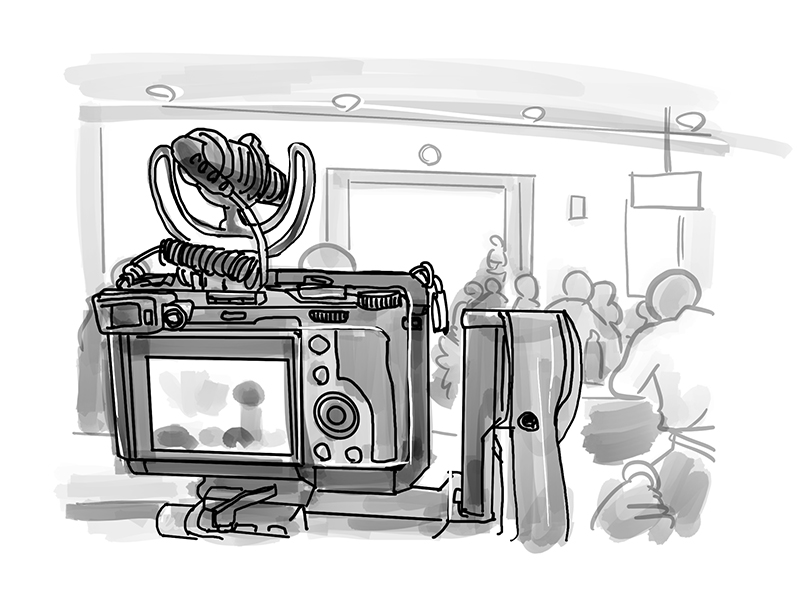

まずは自分の仕事現場の様子を3枚のイラストにし、それぞれ動画を生成してみました。

さあて、描いたイラストはどんな動きをするのでしょうか。

(1)セミナー会場の様子

思わず「おー」と声が出ました。

カメラ本体は動かず、その向こうの「人」だけが動いています。

※後半、突然変な画面になるのは理解できませんが。

(2)インタビュー撮影の様子

2枚目で確信しました。AIは「人」に反応します。

※こちらも、後半は無視することにします。

(3)オンラインセミナーの様子

「人」がいなくても、何かしら動きを付けてくれますね。

意図的に動画生成してみたら

どうやら「人」が入ると面白いと思い、今度は人を含む3枚のイラストを描き、動画にしてみました。

(4)人の大勢の後ろ姿の場合

一瞬「お!」と思ったものの、後半なんだかよくわからない展開になりました。

(5)遠くの群衆の場合

これは期待通り。

遠くの人々のみが動いている感じが出ました。

(6)特定の一人の場合

最後は大本命で楽しみにしていたのですが・・・残念な結果となりました。

うーん、なかなか期待通りには動いてくれませんね。

▼まとめ

今回、手描きイラストという、本来動くはずのないものが動く、というおもしろさを体験しました。

同時に、AIが動かしやすい絵を用意することの重要さにも気づきました。

つくづく、人間とAIのコミュニケーションが始まったと感じます。

「runway/Gen-2」では、あっという間に無料の範囲を使い切ってしまいました。

他にもいろんなツールがあるようなので、このあたりも、また報告したいと思います。

オリカワシュウイチ

映像クリエイター。絵コンテコーチ。 初心者の映画制作をサポートする活動を全国で続ける。埼玉県在住。 仲間ゼロ・カメラ1台から映画作りをスタートし『映画工房カルフのように(http://karufu.net/)』を立ち上げ、セミナーやワークショップを通して、これまで1000人以上に映画作りをアドバイスする。スタローンに生で会ったことのある広島県人。 著書に『事例で学ぶ1分間PR動画ラクラク作成ハンドブック』『iPhoneで作ろう ビジネス動画の教科書』(共にペンコム)がある。